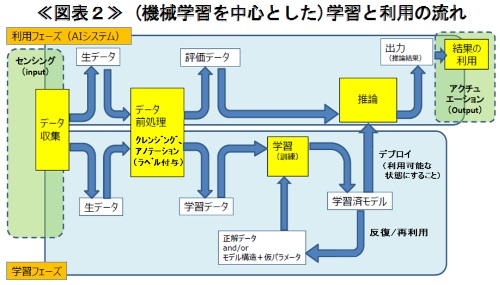

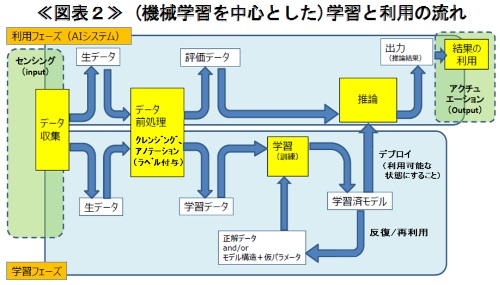

機械学習では、正解データとどの程度のズレがあるかを計算し、その差が最小になるようパラメーターの調整を繰り返すことで学習モデルの精度を高めていく(図表2)。学習はデータに依存し、データの質・量の不足、代表性の不確保(データの偏り)、バイアスの入り込み5等により、学習モデルの精度が損なわれる。

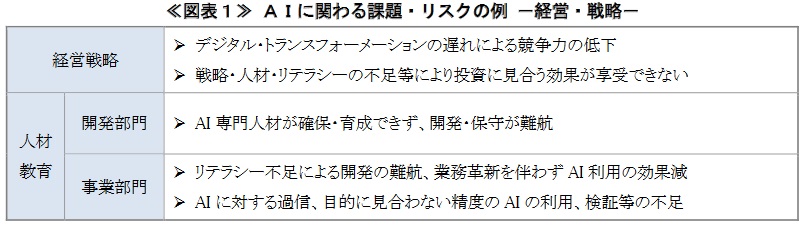

AIに関わるリスクとして、経営・戦略面ではデジタル・トランスフォーメーション(DX)の遅れによる競争力の低下といった戦略リスクと人材リスクが挙げられる(図表1)。

デジタル技術を使ってこれまでにないビジネス・モデルを展開する新規参入者が登場し、ゲームチェンジが起きつつある。情報処理推進機構(IPA)が東証一部上場企業を対象に実施したアンケート調査1によれば、AIやIoT等のデジタル技術の普及による自社への影響について「自社の優位性や競争力の低下」を懸念する回答が最多となっており、国内のリーディング企業であっても現在の競争力を維持できる年数はそれほど長くはない(半数程度の企業が約5年後まで)と認識されている。企業は、競争力維持・強化のためにDXをスピーディーに進めていく必要があり、既存のビジネスの効率化だけではなく、事業構造をAI起点・サービス起点の事業構造へ転換することも必要とされる。

AIに関わる研究・開発人材は大幅に不足しており、また技術者の相当数がIT企業側に偏在している。DXを進め、AIによる便益を最大限享受するためには、AIを開発・応用できる人材の確保・育成を進めるとともに、経営層から従業員までのあらゆる層においてAIを適切に利用するためのリテラシーを高めていく必要がある2。

(出典)各種資料よりSOMPO未来研究所作成

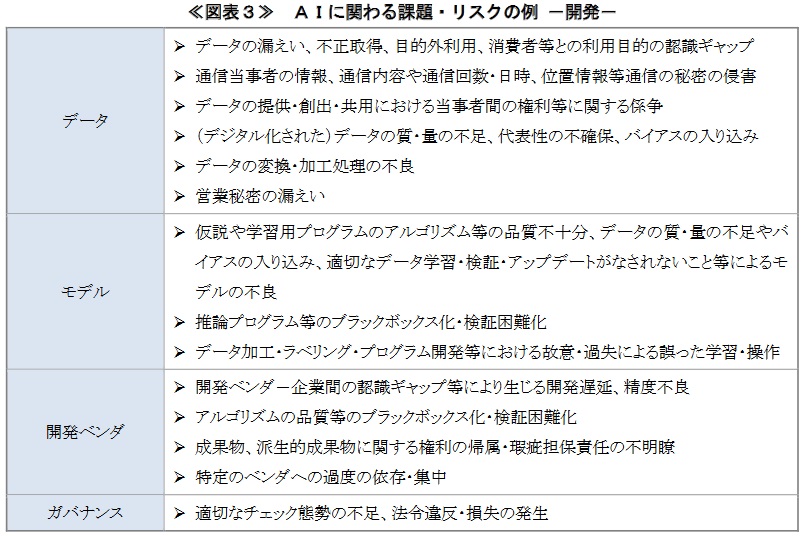

機械学習では、AIの学習と評価に用いるための大量かつ高品質のデータが必要となる。顧客や企業が抱えている問題を洗い出し、ソリューションを検討し、必要なデータの収集やこれまでデジタル化されていなかった情報や知識のデータ化等を進めることとなる。データには権利を有する主体が存在する場合があり、その内容により個人情報保護法、電気通信事業法3、著作権法等の規制対象となる。事業者間でデータを連携する場合においては、データ提供者が保有するノウハウの流出などの懸念が生じる。このような場合にはデータや成果物の利用等について取り決めることが重要となる4。

機械学習では、正解データとどの程度のズレがあるかを計算し、その差が最小になるようパラメーターの調整を繰り返すことで学習モデルの精度を高めていく(図表2)。学習はデータに依存し、データの質・量の不足、代表性の不確保(データの偏り)、バイアスの入り込み5等により、学習モデルの精度が損なわれる。

機械学習は、高い精度の予測は得意だが、予測の根拠の説明は不得意であり、開発者自身や専門家も説明できないというブラックボックス化のリスクを有する。

これらの特性を踏まえ、AIの開発における代表的な課題・リスクを挙げたものが図表3となる。

また、AIの開発・利用においては、技術的なリスクだけではなく、倫理、情報セキュリティ、コンプライアンス、サイバー、開発ベンダ等に関わる複合的なリスクが存在し、企業にはAIの用途等に応じてこれらのリスクに明確に対応する態勢を整備することが求められる。

(出典)各種資料よりSOMPO未来研究所作成

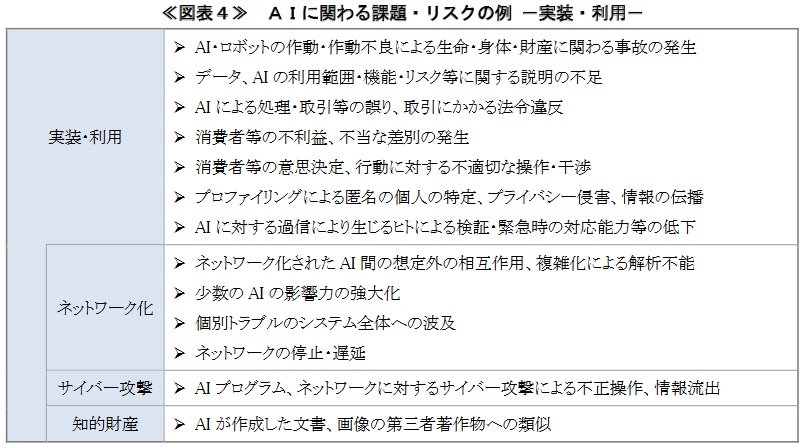

AIの実装・利用において企業にとって特に懸念されるリスクは、AIに関する精度や説明をどこまで確保すればよいか不確実であることと、AIの特性やネットワーク化によりAIに関わるトラブルが製品やサービス全体、システム全体に波及する可能性があることではないだろうか。

製造物責任法の対象となる製造物は有体物である動産に限られており、無体物であるAIそれ自体について製造物責任は成立しない。しかし、AIを組み込んだ製品自体は製造物であり、AIに欠陥がある場合にはメーカーは製造物責任を負う。この場合において何が「欠陥」にあたるのかが問題となる。製造物責任法は、「欠陥」を「通常有すべき安全性を欠いていること」と定義しており、これがAIの予見可能性の低さとどのように関連するかはまだわからない。企業は、AIには制御不可能性や不透明性といった欠点が存在することを十分に理解し、それらの欠点を極小化するための利用可能な設計上の対応策を採用することについて、できうる限り検討しておく必要があると考えられる6。

また、AIがインターネット等を通じて他のAIと接続・連携することにより制御不能となるなどAIがネットワーク化することによってリスクが惹起され、増幅されるおそれがある。企業には、考えられるリスクを分析し、当該リスクを連携の相手方と共有するとともに、予防策や問題が生じた場合の対応策等を整理し、消費者等に対し、必要な情報提供を行うことが期待される7。

AIの利用にあたっては、プライバシー性の高いデータや情報を扱うケースが多い。個人の権利・利益に重要な影響を及ぼす可能性のある分野においてAIを利用したプロファイリングを行う場合には、消費者等に生じうる不利益に慎重に配慮する必要がある。AIへのサイバー攻撃により、AIが犯罪等に悪用されたり、消費者等に被害が生じるリスクも想定され、各企業には、AIの用途・侵害の影響等を踏まえた合理的なセキュリティ対策が求められる8。

(出典)各種資料よりSOMPO未来研究所作成

AIは、Society5.0を実現するための中核技術であり、またPwCによれば世界のGDPを2030年には15.7兆ドル押し上げる効果があると推定されている9。AIは進化を続け、ビジネスに欠かせない経営資源の1つになるだろう。AI活用の効果を高めるためにはリスクを適切にコントロールすることが重要であり、企業は、開発部門だけでなくあらゆる層においてAIに関するリテラシーを向上していく必要がある。

PDF:1MB

PDF書類をご覧いただくには、Adobe Readerが必要です。

右のアイコンをクリックしAcrobet(R) Readerをダウンロードしてください。